Hay un experimento mental muy famoso en ética que se denomina el “dilema del tranvía”. Un tren fuera de control avanza hacia cinco personas. Tenés la posibilidad de accionar una palanca y desviarlo hacia otra vía donde hay una sola persona. Si no hacés nada, mueren cinco. Si intervenís, muere una.

¿Qué deberías hacer?

Este caso se usa desde hace décadas para discutir algo mucho más profundo que es lo correcto, de quién decide, desde qué lógica, con qué valores y con qué legitimidad. Y aunque parezca un juego de filósofos, hoy ese dilema dejó de ser teórico. Está empezando a tomar forma en decisiones reales que toman, o tomarán, sistemas tecnológicos.

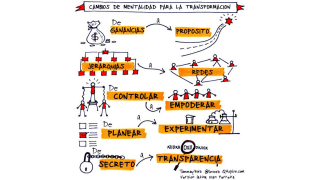

En los últimos años, cada vez que trabajo con PyMEs en procesos de planeamiento estratégico, me pasa algo parecido. Cuando llegamos al momento de hablar de valores, misión y visión, muchas veces descubro que esos valores los definió quien armó la página web. No porque sea mala persona, sino porque la empresa nunca se tomó en serio la discusión. Quedaron como un adorno institucional, un copy lindo, algo menor.

Después, claro, nos preguntamos por qué la cultura no cambia, por qué la gente no se alinea, por qué las decisiones parecen erráticas.

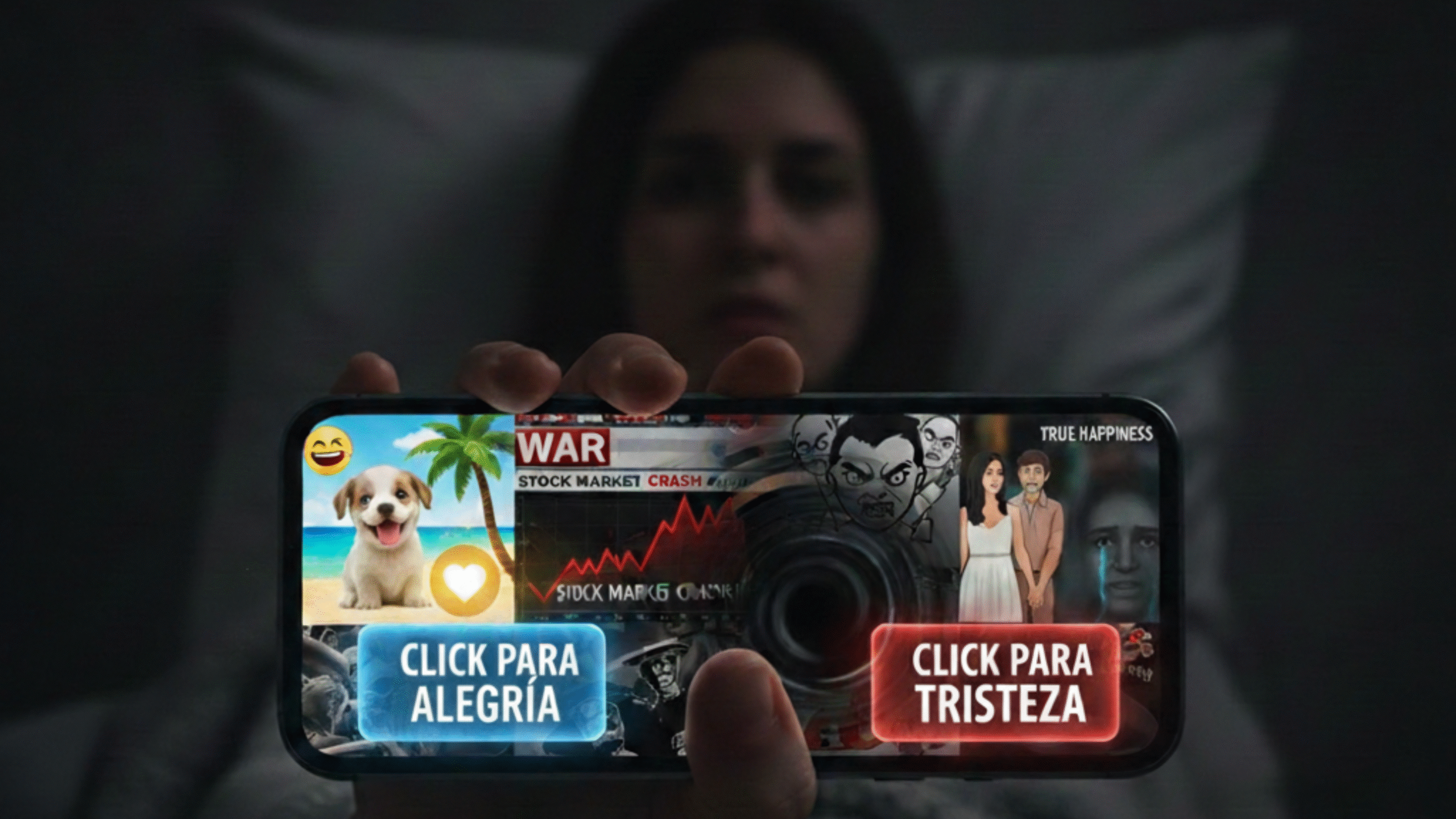

Leé también ¿Felicidad o tristeza? Cómo recuperar el control de tus emociones en las redes

Ahora estamos haciendo exactamente lo mismo, pero en una escala infinitamente más riesgosa. Estamos creando sistemas de inteligencia artificial, autos autónomos y modelos de decisión cada vez más sofisticados, y dejamos que las grandes decisiones de diseño ético queden casi exclusivamente en manos de ingenieros. Sin desmerecer en absoluto su trabajo: el problema no es técnico, es político, social, cultural y humano.

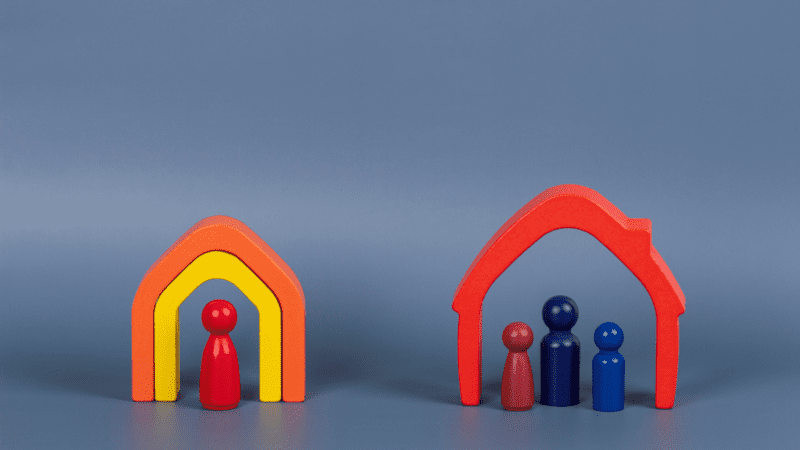

Volvamos al tranvía: ¿qué debería hacer un auto autónomo ante un accidente inevitable? ¿Priorizar al pasajero? ¿Al peatón? ¿Al grupo mayor? ¿A quien cruzó “mal”?

La pregunta no es solo qué algoritmo es más eficiente. La pregunta es: ¿quién define los valores que ese algoritmo va a ejecutar?

Las decisiones éticas y el avance de la IA

Byung-Chul Han lo dice de forma brutal en No-cosas: “La inteligencia artificial puede calcular con rapidez, pero le falta espíritu” y “la inteligencia artificial nunca alcanza el nivel conceptual del saber. No comprende”.

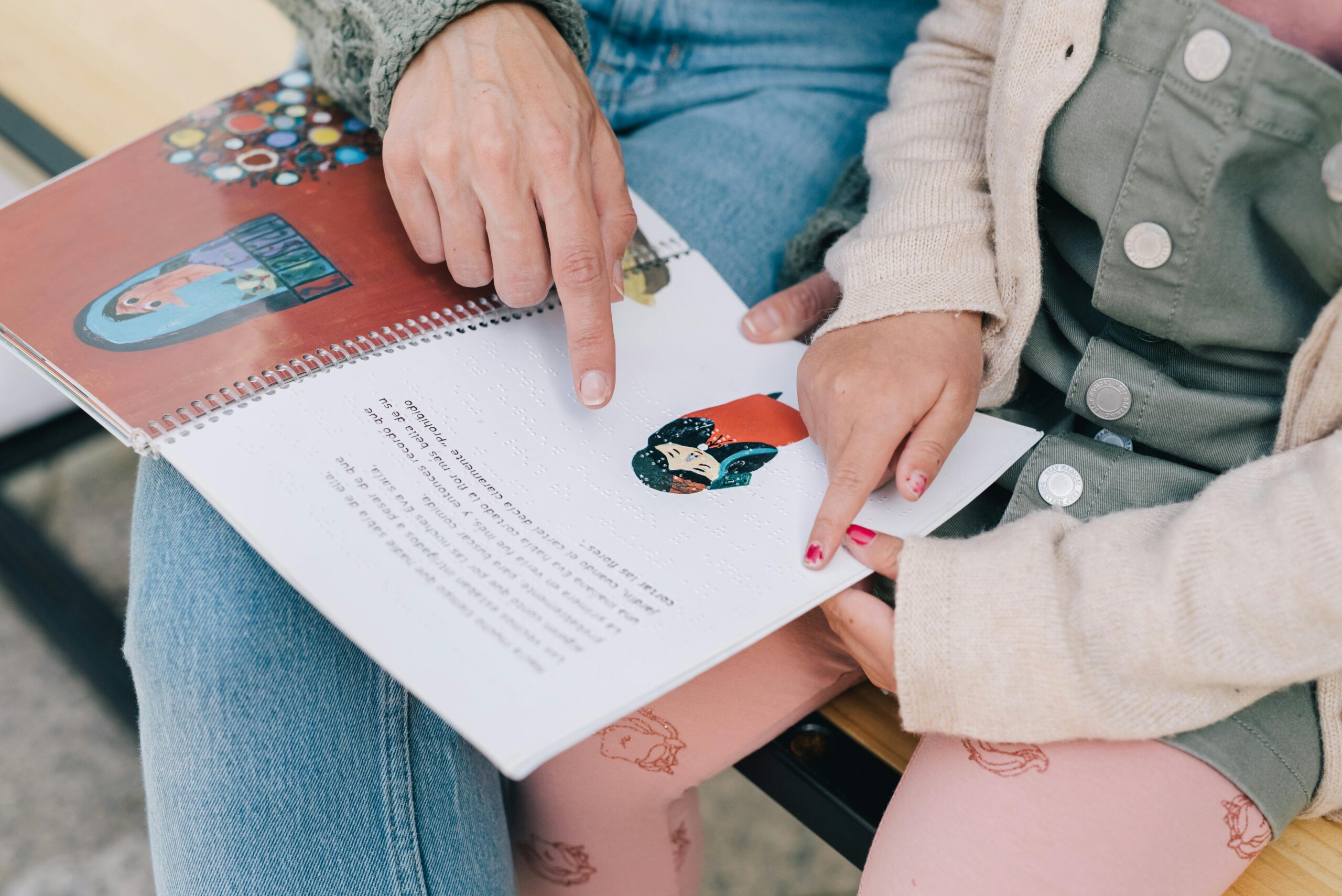

Puede procesar millones de datos, pero no entiende el sentido de una vida, el peso de una pérdida, el valor simbólico de una decisión. Eric Sadin, en La inteligencia artificial o el desafío del siglo, advierte algo parecido, afirma que la velocidad de procesamiento de las máquinas no sigue la misma lógica que nuestros tiempos de deliberación, de duda, de conflicto moral. La máquina decide rápido. Los humanos dudamos. Y en esa duda, paradójicamente, hay humanidad.

El problema no es que la tecnología avance. El problema es que estamos delegando, casi sin debate público, un conjunto enorme de decisiones éticas en sistemas que no sienten, no comprenden y no cargan con las consecuencias. Y peor aún, estamos llegando tarde a la conversación. Cuando los sistemas estén completamente desplegados, cuando las reglas estén codificadas en millones de líneas de software, ya no habrá mucho margen para discutir qué valores queríamos.

Esto no es un tema solo para ingenieros, programadores o empresas tecnológicas. Es un tema para organizaciones, gobiernos, universidades, medios y ciudadanos. Así como no le delegaríamos a un diseñador web la definición profunda de los valores de una empresa, tampoco podemos delegar a un equipo técnico, por más brillante que sea, la arquitectura moral de los sistemas que van a influir en nuestras vidas. El dilema del tranvía nos incomoda porque no tiene una respuesta fácil. Pero su valor no está en encontrar la solución correcta, sino en obligarnos a hacernos cargo de que decidir implica asumir una visión del mundo.

La pregunta no es si la inteligencia artificial va a tomar decisiones. La pregunta es con qué valores lo va a hacer, y quién se tomó el trabajo de discutirlos antes de que fuera demasiado tarde.

Alejandro Lang es Lic en Administración y MBA. Consultor y profesor especializado en estrategia, innovación y habilidades de gestión. alejandro.lang@hulknegocios.com

Este contenido es posible gracias al apoyo de nuestros lectores y auspiciantes. Compartí esta nota, opiná, y publicitá en nuestra web, para promover un periodismo distinto en la región: Contacto y Publicidad. La Pampa Noticias.

La Pampa 2026

La Pampa 2026